Αυτή ήταν μια άγρια χρονιά για την τεχνητή νοημοσύνη. Εάν έχετε περάσει πολύ χρόνο στο διαδίκτυο, πιθανότατα έχετε συναντήσει εικόνες που δημιουργούνται από συστήματα τεχνητής νοημοσύνης όπως το DALL-E 2 ή το Stable Diffusion, ή αστεία, δοκίμια ή άλλο κείμενο που γράφτηκε από ChatGPTη τελευταία ενσάρκωση του μοντέλου GPT-3 της μεγάλης γλώσσας του OpenAI.

Μερικές φορές είναι προφανές όταν μια εικόνα ή ένα κομμάτι κειμένου έχει δημιουργηθεί από ένα AI. Αλλά όλο και περισσότερο, η απόδοση που παράγουν αυτά τα μοντέλα μπορεί εύκολα να μας ξεγελάσει και να πιστεύουμε ότι κατασκευάστηκε από άνθρωπο. Και ιδιαίτερα τα μεγάλα γλωσσικά μοντέλα είναι σίγουρες μαλακίες: δημιουργούν κείμενο που ακούγεται σωστό αλλά στην πραγματικότητα μπορεί να είναι γεμάτο ψέματα.

Αν και αυτό δεν έχει σημασία αν είναι απλώς λίγο διασκεδαστικό, μπορεί να έχει σοβαρές συνέπειες εάν χρησιμοποιούνται μοντέλα τεχνητής νοημοσύνης για να προσφέρουν αφιλτράριστες συμβουλές υγείας ή να παρέχουν άλλες μορφές σημαντικών πληροφοριών. Τα συστήματα τεχνητής νοημοσύνης θα μπορούσαν επίσης να κάνουν ανόητα εύκολη την παραγωγή σωρού παραπληροφόρησης, κατάχρησης και ανεπιθύμητης αλληλογραφίας, παραμορφώνοντας τις πληροφορίες που καταναλώνουμε, ακόμη και την αίσθηση της πραγματικότητας. Θα μπορούσε να είναι ιδιαίτερα ανησυχητικό για τις εκλογές, για παράδειγμα.

Ο πολλαπλασιασμός αυτών των εύκολα προσβάσιμων μεγάλων γλωσσικών μοντέλων εγείρει ένα σημαντικό ερώτημα: Πώς θα ξέρουμε αν αυτά που διαβάζουμε στο Διαδίκτυο είναι γραμμένα από άνθρωπο ή μηχανή; έχω μόλις δημοσίευσε μια ιστορία εξετάζοντας τα εργαλεία που έχουμε αυτήν τη στιγμή για να εντοπίσουμε κείμενο που δημιουργείται από AI. Ειδοποίηση Spoiler: Το σημερινό κιτ εργαλείων ανίχνευσης είναι θλιβερά ανεπαρκές έναντι του ChatGPT.

Αλλά υπάρχει μια πιο σοβαρή μακροπρόθεσμη επίπτωση. Ίσως γινόμαστε μάρτυρες, σε πραγματικό χρόνο, της γέννησης μιας χιονόμπαλας από μαλακίες.

Τα μεγάλα γλωσσικά μοντέλα εκπαιδεύονται σε σύνολα δεδομένων που δημιουργούνται με απόξεση κειμένου στο διαδίκτυο, συμπεριλαμβανομένων όλων των τοξικών, ανόητων, ψευδών, κακόβουλων πραγμάτων που έχουν γράψει οι άνθρωποι στο διαδίκτυο. Τα ολοκληρωμένα μοντέλα τεχνητής νοημοσύνης επαναλαμβάνουν αυτά τα ψέματα ως γεγονός και η παραγωγή τους διαδίδεται παντού στο διαδίκτυο. Οι εταιρείες τεχνολογίας ξύνουν ξανά το Διαδίκτυο, συλλέγοντας κείμενο γραμμένο με τεχνητή νοημοσύνη που χρησιμοποιούν για να εκπαιδεύσουν μεγαλύτερα, πιο πειστικά μοντέλα, τα οποία οι άνθρωποι μπορούν να χρησιμοποιήσουν για να δημιουργήσουν ακόμα περισσότερες ανοησίες πριν το ξύσουν ξανά και ξανά, ad nauseam.

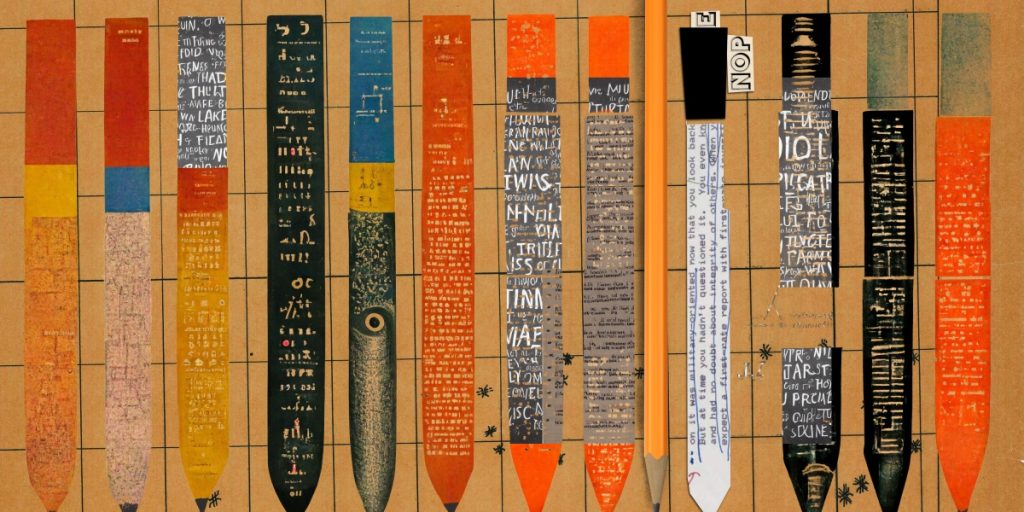

Αυτό το πρόβλημα —το AI που τροφοδοτείται από τον εαυτό του και παράγει όλο και πιο μολυσμένο αποτέλεσμα— εκτείνεται και στις εικόνες. «Το Διαδίκτυο είναι πλέον μολυσμένο για πάντα με εικόνες που δημιουργούνται από AI», είπε ο Μάικ Κουκ, ερευνητής τεχνητής νοημοσύνης στο King’s College του Λονδίνου, στον συνάδελφό μου Will Douglas Heaven. νέο κομμάτι για το μέλλον των μοντέλων τεχνητής νοημοσύνης.

«Οι εικόνες που φτιάξαμε το 2022 θα είναι μέρος οποιουδήποτε μοντέλου που κατασκευάζεται από εδώ και πέρα».